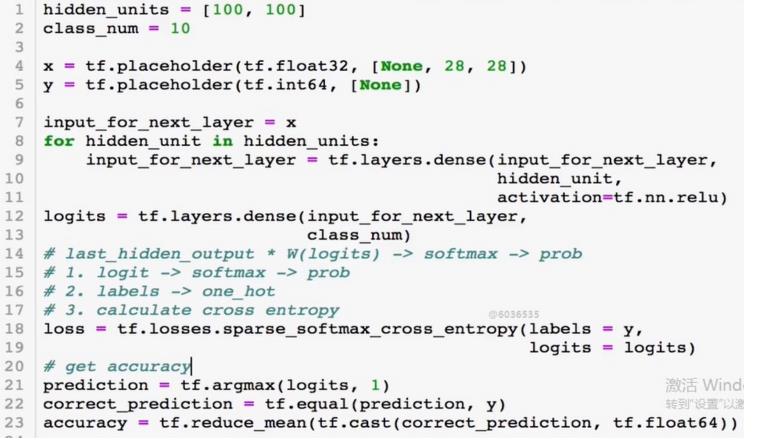

tf.argmax &logits

老师,请教您如下问题:

1.one-hot编码中用多少位表示原来y中的一个值,比如y的类别有2个猫和狗,

猫就是10 ,狗就是01,这样一个类别占用了2个数字的位置,也就是2个字符位表示,y有多少个类别one-hot编码就用多少位01字符表示么

2.y做one-hot编码前是一维的向量吧,y通过那个cross_entropy函数做了one-hot编码后的shape呢?

3.prediction=tf.argmax(logits,1),

因为argmax的第二个参数是1,所以logits肯定是一个数组,至少是二维或者多维数组,如果logits是一个mxn的数组,那么这个argmax返回的是一个长度为m的一个向量,这个向量中的每个元素是logits数组每一列最大值对应的索引,这样理解的对么?

4.假设第3步我理解的正确,但是argmax返回的向量中元素是索引值,怎么能和ne-hot编码后的y进行equal的?量纲不匹配呀?

5.这个网络结构每层的输出shape是多少?

输入层x的shape Nonex28x28

假设输入层与第一个隐藏层之间的权重矩阵是W1是mxn的矩阵,b1是Bias

第一个隐藏的输出的值和shape是多少,怎么算的?

假设输入层与第二个隐藏层之间的权重矩阵是W2是axb的矩阵,b2是Bias

第二个隐藏的输出的值和shape是多少,怎么算的?

假设第二个隐藏层和最后的输出层之间的权重矩阵是W3是gxh的矩阵,b3是Bias

输出层logits的值和shape怎么计算的,是多少