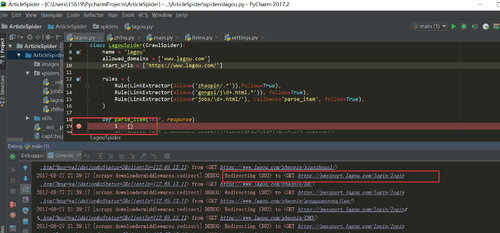

课程6-4 调试拉钩网爬取url,response为302重定向为登录页面,没有进入调用callback函数parse_item,提取不到后续url

1003

收起

正在回答 回答被采纳积分+3

1回答

Scrapy打造搜索引擎 畅销4年的Python分布式爬虫课

- 参与学习 5831 人

- 解答问题 6293 个

带你彻底掌握Scrapy,用Django+Elasticsearch搭建搜索引擎

了解课程