参数设置

从上到下依次为图1,图2[滑到最底端]

1.为什么max_length设置成500,依据什么设置的?

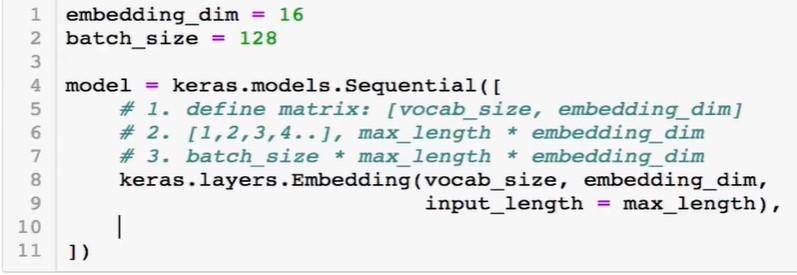

2.7-2中的vocab_size=10000依据是什么

3.每个词对应的数字映都要映射成16长度的向量么,如下图1所示

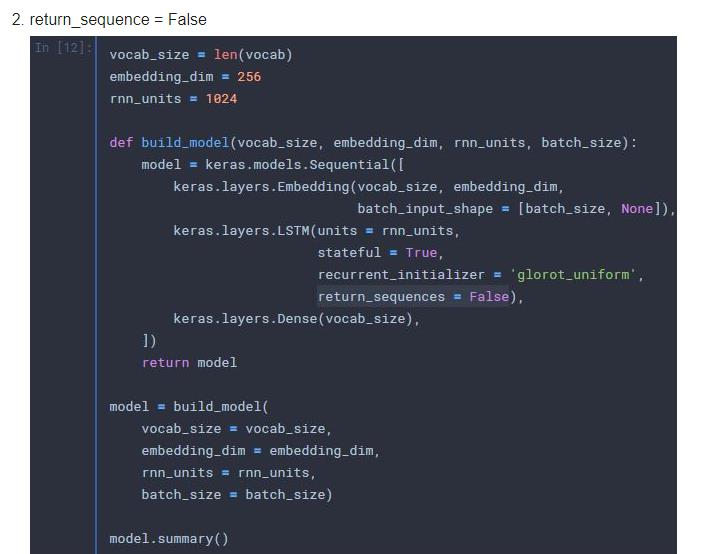

4.为什么7-5同学提的问题中的vocab_size写的是len(vocab),

但是老师在7-3中却将vocab_size设成了一个常量10000,而不是vocab的长度?

如下图2所示:

541

收起