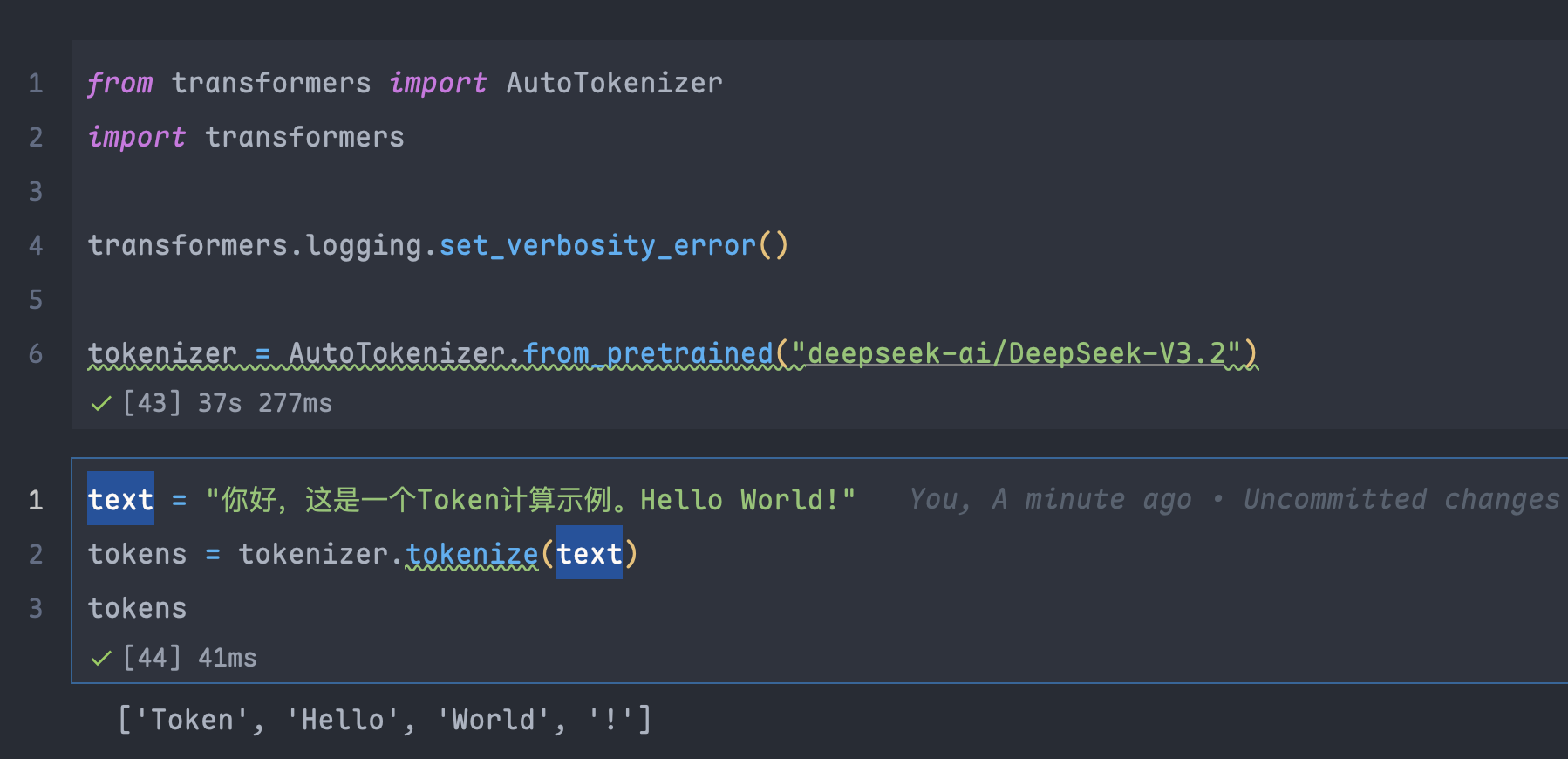

deepseek模型分词中文丢失

上面使用 deepseek-v3.2模型,分词结果中文丢失了,使用 deepseek-v3 版本也是一样的,我看老师你讲课过程中是直接能够输出结果的,是我这边缺少了什么设置吗?

环境信息:

transformers=5.3.0

Python=3.12.13

14

收起

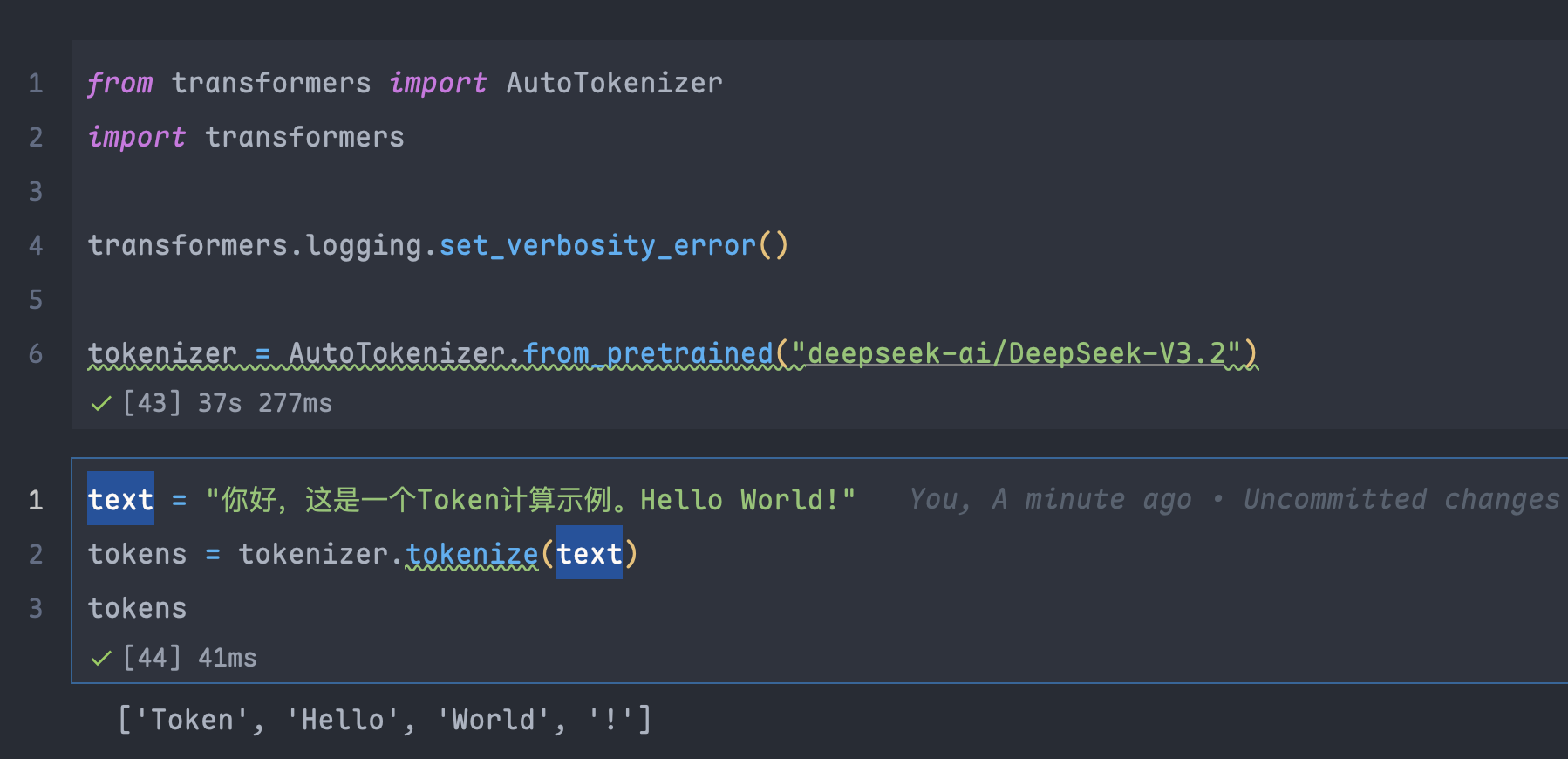

上面使用 deepseek-v3.2模型,分词结果中文丢失了,使用 deepseek-v3 版本也是一样的,我看老师你讲课过程中是直接能够输出结果的,是我这边缺少了什么设置吗?

环境信息:

transformers=5.3.0

Python=3.12.13