关于 messages

# 2.调用语言模型获取响应内容

message = await self._invoke_llm(

[{"role": "user", "content": query}],

format,

)

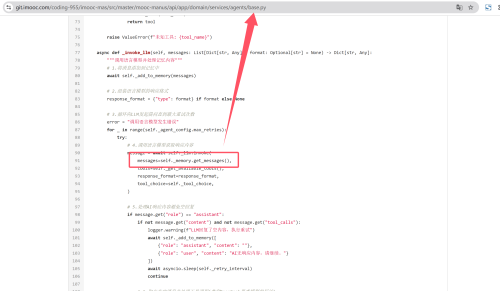

老师这里的_invoke_llm()调用 llm 的 invoke(),messages参数都是当前这一条,不是应该包含历史消息吗?

69

收起