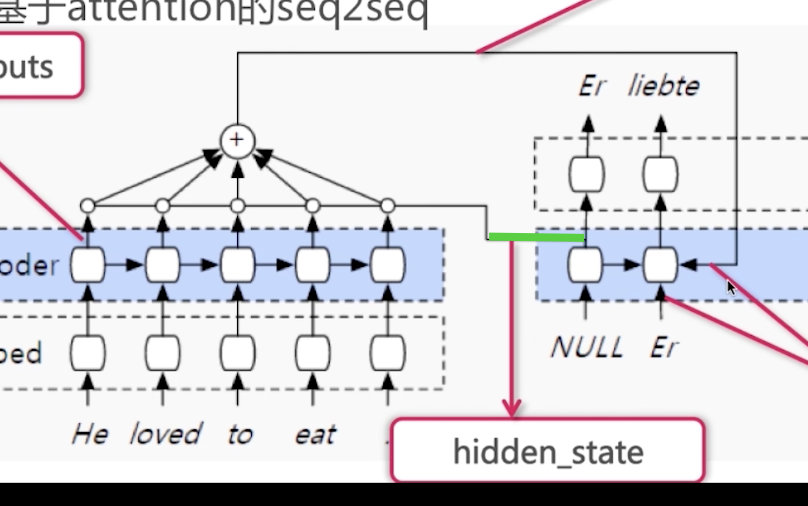

decoder中的gru隐状态

decoder中的gru隐状态初始值我看您在第一节课件中描述的是encoder最后的隐状态。但是代码中没有体现。self.gru = keras.layers.GRU(self.decoding_units, return_sequences=True, return_state=True, recurrent_initializer='glorot_uniform')。不知道是不是我理解错了,希望老师能帮忙看下这个问题。谢谢

866

收起